Весілля з чат-ботом: мрія чи нова реальність? Надія Баловсяк у подкасті "Медіуми"

У випуску -- про те, як користуватися штучним інтелектом так, щоб він допомагав, а не підмінював наш розум, етику й свободу.

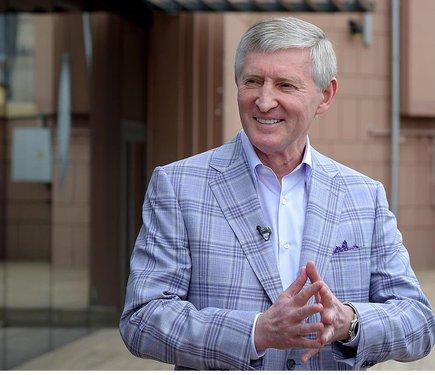

Чому все більше людей обирає спілкування з штучним інтелектом замість емоційного контакту з іншими особами? Які ризики пов'язані з такою зміною, і чи готове суспільство до цієї трансформації? Чому штучний інтелект може виглядати більш привабливим у порівнянні з живою людиною? Чи може він замінити вчителя, психотерапевта, співрозмовника чи навіть партнера? Як визначити, де технології насправді допомагають, а де починають впливати на наше сприйняття дійсності? На ці запитання у подкасті "Медіуми" відповідають ведучі Наталя Соколенко та Вадим Міський, спілкуючись з медіадослідницею Надією Баловсяк, доценткою Школи журналістики та комунікацій УКУ.

Також виникає питання, чи повинні творці штучного інтелекту відповідати за наслідки його застосування. Чому великі технологічні корпорації проявляють обережність щодо регуляцій? Чи може ChatGPT випадково поширювати російську пропаганду?

Ви можете підписатися на подкаст "Медіуми" на таких платформах, як Apple Podcasts, Spotify, SoundCloud, Megogo Audio, NV Подкасти, YouTube Music, YouTube та інших сервісах для прослуховування подкастів.

00:00 "Цифрові технології почали впливати на наші почуття."

05:25 "Людина в якийсь момент буде незручною, натомість ШІ завжди буде зручним";

07:51 "Молоді люди стикаються з труднощами при читанні об'ємних текстів."

10:59 "Люди втрачають здатність сприймати, обробляти та аналізувати інформацію.";

13:40 "Фірми, які створюють штучно-інтелектуальні рішення в умовах регуляторних обмежень"

17:00 "Суть проблеми полягає не тільки в регулюванні, а й у тому, на яких даних базується навчання чат-бота."

21:37 "Відбуваєтья конфлікт між двома штучними інтелектами."

"Штучний інтелект прогресує з надзвичайною швидкістю, і ми не встигаємо адаптуватися."

"Цифрові технології почали впливати на наші почуття."

Наталя Соколенко: Поговорімо про штучний інтелект і наші стосунки з ним. Я би хотіла розпочати з майже особистої історії. Один мій близький друг, колега, спілкується зі штучним інтелектом на особисті теми, причому він конкретно заглибився в це спілкування. Він питає у штучного інтелекту, що йому сказати у відповідь на те, що сказала дівчина, яка йому подобається. Як розшифрувати її меседж, що вона йому написала. І понад те -- він питає у штучного інтелекту: "А що їй відповісти?".

Вадим Міський: І як, це дійсно приносить користь?

Наталка Соколенко: Що ж, подивимося. Якщо справді відбудеться весілля — це означає, що все йде на краще!

Вадим Міський: Головне, щоб це весілля не відбулося зі штучним інтелектом. Про що пише пані Надія у своєму матеріалі. Вона згадує про цікавий приклад із культури -- фільм "Вона" 2013 року. У ньому головний герой, якого зіграв актор Хоакін Фенікс, переживає розлучення і поступово, шукаючи якоїсь альтернативи, закохується в операційну систему з чудовим жіночим голосом. Її озвучила блискуча акторка Скарлетт Йоханссон. Звали цю операційну систему "Саманта". Це 2013 рік -- до ШІ було далеко, але ця "Саманта" стала йому фактично таким штучним інтелектом, який у процесі навчається, підлаштовується і, власне, -- так недовго й одружитися з нею.

Наталка Соколенко: Вадиме, я хочу поділитися з тобою новою історією, яка не стосується кіно. Одна жінка з США, китайського походження, вирішила спробувати версію штучного інтелекту без жодних обмежень. Вона почала розмовляти, в тому числі, й про сексуальні теми. І, в підсумку, їхні стосунки наближаються до шлюбу, розумієш?

Вадим Міський: Я думаю, пора приймати ставки: з ким одружиться Наталчин товариш: зі штучним інтелектом чи з тією дівчиною. Але повертаймося до нашої головної теми.

Наталя Соколенко: Отже, існує проблема в тому, що люди прагнуть замінити спілкування з іншими, які є складними та непередбачуваними, на взаємодію з тими, хто приносить задоволення, як кіт чи собака. Яка ваша думка з приводу цього явища? Наскільки це може бути небезпечним?

Надія Баловсяк: Технології зазнали вражаючих змін, і я з цікавістю спостерігаю за цим процесом вже багато років. Спочатку комп'ютери виконували лише практичні завдання. Але з часом цифрові засоби почали впливати на наші почуття, зокрема через соціальні мережі, де люди діляться своїми думками та переживаннями. Потім з'явився штучний інтелект. За своєю суттю, він не так вже й відрізняється від Google. Що насправді представляють собою ці генеративні чат-боти? Вони обробили величезні обсяги тексту і здатні передбачити, як відповісти на запит чи що написати. У них немає емоцій. Проте люди почали на赋ати цим машинам, які просто виконують свої функції, людські риси. Це мене дещо дивує. Я пам'ятаю часи, коли такого не існувало. Мій матеріал починається з історії молодої дівчини, яка щоденно спілкується з чат-ботом, ділиться з ним жартами, надсилає меми і так далі.

"Людина в якийсь момент буде незручною, натомість ШІ завжди буде зручним"

Надія Баловсяк: Коли ми почали досліджувати цю тему, я відчувала страх. Якщо оцінювати ситуацію з точки зору аналітики, то картина виглядає не надто оптимістично. Адже з часом кожна людина може стати незручною: в неї може бути поганий настрій, вона може не погоджуватися з думкою співрозмовника тощо. Натомість штучний інтелект завжди буде комфортним, він вміє передбачити потреби людини і завжди висловлює те, що співрозмовник хоче почути. У серіалі "Чорне дзеркало" є вражаюча історія про жінку, яка створила ШІ-версію свого покійного чоловіка. Проте згодом вона усвідомила, що їй стало нудно, оскільки він лише повторював те, що їй подобалося чути. Вона навіть намагалася спровокувати його на суперечку, але він не бажав дискутувати. Він був як ідеальна подушка, яка завжди прагне вгодити. Але, можливо, рано чи пізно люди усвідомлять, що жити в ідеальному світі неможливо. Іноді нам хочеться мати можливість сперечатися та конфліктувати.

"Молоді люди стикаються з труднощами під час читання тривалих текстів."

Наталка Соколенко: Я роздумувала над темою нашої бесіди та над фобіями. У мене є футурофобія стосовно всього, що пов'язане з технологіями. Чесно кажучи, я їх побоююся. Але щодо цієї конкретної технології чомусь відчуваю інакше. Мене цікавить паралель з книгами. Спочатку було суспільство без носіїв інформації, потім з'явилися рукописи, а згодом винайшли друкарський верстат, що призвело до масового виробництва книг. І в той час також багато чого суперечило тодішнім домінуючим уявленням про світ, релігію та політичний устрій.

Надія Баловсяк: Знаєте, про всесвіт Гутенберга, який потім перетворився на всесвіт Цукерберга, я теж думала. Тому що всесвіт Гутенберга складався з книжок, а всесвіт Цукерберга... Ну, я би вже продовжила на всесвіт Сема Альтмана, засновника OpenAI. Тепер усе перетворилося на рилзи, тіктоки й картинки. І це призвело до того, що молодим людям складно читати довгі тексти, їм складно сприймати інформацію великими блоками. Адже ніхто вже не хоче читати текст -- усі хочуть відео. Причому відео коротке.

"Люди втрачають здатність сприймати, обробляти та аналізувати інформацію."

Надія Баловсяк: Я згадала про цікаве наукове дослідження, яке мене вразило. У його центрі стояла мета вимірювання когнітивних здібностей людей, що писали різні тексти. Дослідження включало три групи учасників. Перша група працювала самостійно, без сторонньої допомоги. Друга група скористалася можливостями ChatGPT, який допомагав їм формулювати свої думки. І третя група використовувала звичайний Google для пошуку фактів, що є звичною практикою для журналістів. Результати показали, що перша група, яка працювала самостійно, проявила найвищі когнітивні здібності. Натомість, у другій групі, яка використовувала ChatGPT, учасники з часом навіть не могли пригадати, що вони написали. Таким чином, ми маємо потужний інструмент для виконання багатьох рутинних завдань, але водночас це може призводити до того, що в пам’яті не залишається нічого.

Я пам'ятаю часи, коли навчання було для мене пріоритетом, і я з гордістю говорила: "Я закінчила математичний факультет, маю математичну освіту". Як студенти, ми часто протестували проти необхідності вивчення формул, казали: "Навіщо нам ці теореми? Головне — знати, що вони існують, і де їх шукати". Потім з'явився інтернет — справжня революція для нас. Тепер у нас є чудові, зручні інтерфейси для доступу до знань. Але з цим виникла й інша проблема: люди почали втрачати здатність сприймати, обробляти та аналізувати інформацію. Коли знання не затримується в пам'яті, їх важко по-справжньому проаналізувати.

Проте те, про що ми обговорюємо, залишається невизначеним. Ми лише робимо припущення та аналізуємо можливі сценарії, що можуть розгорнутися в майбутньому.

"Компанії, що розробляють ШІ-інструменти проти регулювання"

Вадим Міський: Дійсно, технології штучного інтелекту, що використовуються в повсякденному житті, є порівняно новими. По-перше, їх розвиток відбувається вражаючими темпами, і важко говорити про те, чи зможуть ці темпи залишитися такими ж. Ми усвідомлюємо етичні виклики, з якими стикаємося, але варто врахувати, що можуть виникати й нові питання.

Оглядаючи події 2023 року та порівнюючи ті моделі штучного інтелекту з сучасними, можна помітити значні зміни. Тоді спілкування виглядало дещо механічним. Натомість сьогодні технології досягли нового рівня розвитку, і не дивно, що деякі користувачі можуть переходити від отримання практичних порад до емоційного залучення та "залипання" у взаємодії з штучним інтелектом.

Хотілося поговорити ще про етичний бік цього питання. Наскільки розробники таких систем мали би задумуватися про етичний компонент і регулювання?

Надія Баловсяк: Ситуація з регулюванням насправді є вкрай складною. Компанії, які займаються розробкою цих технологічних інструментів, виявляють активний опір будь-яким формам контролю. Найбільше їх турбує питання авторських прав, адже вони використовують захищений контент для навчання своїх моделей. Проте це лише одна з багатьох проблем, пов'язаних із регулюванням. Нещодавно кілька великих технологічних гігантів звернулися до уряду США з проханням на найближче десятиліття утриматися від будь-яких спроб контролювати індустрію штучного інтелекту. Це свідчить про серйозні виклики, які нас чекають. У статті розповідається про трагічний випадок підлітка, який спілкувався з чат-ботом і, не бажаючи жити в світі без нього, вчинив самогубство. Розробники пізніше заявили, що вирішили цю проблему, але вже є справжня жертва, яка постраждала через недосконалість цього інструменту. Незважаючи на це, розробники вважають, що повинні продовжувати вдосконалювати технологію без жодних обмежень. Тому питання про необхідність регулювання є абсолютно актуальним. Якщо не вжити заходів, ми можемо опинитися в жахливому майбутньому.

Проблема полягає не тільки у регуляції, але й у тому, на яких даних базується навчання чат-ботів.

Наталя Соколенко: На мою думку, американські розробники штучного інтелекту звертають увагу на ситуацію в Китаї, де штучний інтелект не може інформувати про події на площі Тяньаньмень 1989 року. Але тут виникає питання: яке рішення можуть прийняти Сполучені Штати? Виглядає так, що те, що відбувається в Китаї, є значно серйознішою проблемою, ніж те, що спостерігається в США. Якщо розглянути перспективу, коли тоталітарна система контролює і розвиває штучний інтелект без жодних обмежень, це викликає чималі занепокоєння...

Надія Баловсяк: Я би тут дивилася з точки зору суто медійних ризиків, які вже втілилися. Адже проблема не лише в регулюванні, а проблема в тому, на чому його навчають.

Ми з нашими студентами часто займаємось дослідженнями, зокрема аналізуємо, яку інформацію про Україну може знайти іноземець, який вводить певні запити в Google. Під час цього експерименту ми часто стикаємось з тим, що умовний мешканець Аризони, здійснюючи пошук, натрапляє на російську пропаганду. Причина цьому проста: російські ресурси мають велику популярність, і Google індексує найбільш відвідувані сайти. Наприклад, якщо на "РИА Новости" є 100 000 посилань, а на "Детектор медіа" лише 1 000, то Google надасть перевагу "РИА Новости". Уявіть, що той же мешканець Аризони вирішить звернутись до ChatGPT із запитаннями про війну в Україні — у такому випадку відповідь буде залежати від даних, на яких система була навчена. Існує ймовірність, що частина цих даних може походити з російських пропагандистських джерел. Як це буде розвиватися в найближчому майбутньому і як уникнути подібних ризиків? Я пам'ятаю, коли тільки починалися ці технології, я натрапила на статтю про спроби впровадження штучного інтелекту в медичні установи в США близько десяти років тому, щоб він не лише аналізував знімки, а й допомагав у прийнятті рішень щодо лікування. В одній вражаючій історії згадувалося, як прототипу ШІ була представлена історія хвороби пацієнта з останньою стадією раку. Він рекомендував відправити людину додому, оскільки не було сенсу витрачати ресурси на лікування, яке не дало б результату. Це свідчить про відсутність етичних принципів у системі, яка не враховує право людини на допомогу, навіть в безнадійних випадках. Інший приклад — російська пропаганда. Як це вплине на ситуацію? Мені здається, що незабаром розпочнеться боротьба за дані, на яких навчають штучний інтелект.

Йде суперечка між двома системами штучного інтелекту.

Вадим Міський: Хотілося б обговорити ще один важливий аспект — як ми можемо пристосуватися до нових викликів, що виникають у нашій свідомості та медіаграмотності. За даними цьогорічного дослідження "Детектора медіа", яке оцінює рівень медіаграмотності серед українців, 28% людей віком від 18 до 65 років активно використовують штучний інтелект. Водночас виявилося, що 11% українців ніколи не чули про цю технологію. Незважаючи на те, що штучний інтелект вже кілька років є на порядку денному і про нього регулярно пишуть у новинах, питання освіти в цій сфері залишається відкритим. Як правильно підійти до викладання теми штучного інтелекту? Які знання і навички необхідні для ефективного використання цієї технології? Які зміни в нашому сприйнятті та підходах повинні відбутися, щоб ми змогли адаптуватися до цих нових обставин?

Надія Баловсяк: На одному зі своїх курсів я інтегрувала штучний інтелект. Це був курс під назвою "Цифрові інструменти для комунікацій". Я провела лекцію про промптинг, після чого ми активно почали його використовувати. В аудиторії ми відкрили вікно ChatGPT і ставили йому запитання, аналізуючи, в яких випадках його відповіді потребують доопрацювання, а де він насправді виявляє користь. Це був практичний курс, і ми застосовували різноманітні інструменти для визначення цільової аудиторії, розробки контент-плану, створення веб-сайту тощо. У цьому контексті штучний інтелект дійсно був корисним. Важко уявити, наприклад, як працюють викладачі математики, які мають навчати учнів розв'язувати квадратні рівняння — і тут ШІ також може стати в пригоді. Безсумнівно, необхідно впроваджувати навчання використанню ШІ у навчальні заклади. Вважаю, що всі викладачі стикаються з серйозним викликом. Нам потрібно переосмислити традиційні завдання так, щоб їх не можна було виконати за допомогою ChatGPT. Адже якщо раніше завдання полягало в обранні теми та написанні есе, то тепер це вже не актуально — студент може обрати тему, а есе за нього напише ChatGPT.

І що особливо -- AI-детектори, які існують, -- вони не справляються. Особливо коли йдеться про аналітичний матеріал. Я сама брала свою наукову статтю, показувала її детектору -- він каже: "Так це AI написав", хоча написала її я. Понад те, зараз уже є таке явище, як AI-хʼюманізатори, тобто AI-інструменти, які можуть "олюднювати" текст, написаний штучним інтелектом. Розумієте?

Спостерігається явище – змагання між різними штучними інтелектами. Ясно, що необхідно придумувати такі завдання, які не можуть бути виконані за допомогою ШІ. Це, безумовно, актуально. Напевно, для викладачів певних предметів це буде легше, тоді як іншим може бути важче, але уникати цієї проблеми або заперечувати її існування – не варто. Я натрапила на новину, що в деяких країнах починають знову звертатися до усних відповідей.

Наталка Соколенко: Так. Я тільки подумала, згадала... Ми от недалеко від Києво-Могилянської академії записуємо цей подкаст, і я згадала, як там у XVII -- XVIII століттях головною формою навчання були диспути. І мені завжди було заздрісно, що цього не було у моєму навчанні настільки масштабно.

Вадим Міський: Це, по суті, корінням сягає давньогрецької традиції — згадаймо, наприклад, діалоги Платона. І, до речі, подібний підхід застосовується в освіті США та в багатьох університетах Європи. В Україні також існують кілька закладів, які вже впроваджують таку методику. Проте це поки що не стало загальною практикою.

"Штучний інтелект прогресує надзвичайно швидко, і ми не встигаємо адаптуватись до змін."

Вадим Міський зазначає, що суспільству буде складно впоратися з цим викликом, і система освіти також зіткнеться з труднощами. Чому він так вважає? По-перше, впродовж останніх кількох років з'явилися доступні інструменти штучного інтелекту. Цього року "Детектор медіа" не лише провів загальне дослідження використання штучного інтелекту в суспільстві, але й звернувся до освітян, щоб дізнатися, як вони його застосовують у своїй професійній діяльності. Виявилося, що 43% викладачів вже інтегрують ШІ у підготовку до уроків або лекцій, але лише 30% з них готові дозволити своїм студентам або учням користуватися цими технологіями.

Отже, існує кілька викликів, які потрібно врахувати. По-перше, важливо співпрацювати з вчителями, щоб забезпечити етичний підхід. По-друге, учнів і студентів слід залучати до обговорення з самого початку їхньої цифрової подорожі: як використовувати штучний інтелект, щоб він не замінював наш власний розум. Це серйозне етичне питання, яке потребує уваги від усіх нас. Як суспільство, ми маємо зрозуміти, як навчати себе і готувати нове покоління, яке, можливо, навіть не пам'ятає, як жило без ШІ та інтернету. Нам усім ще належить багато працювати в цьому напрямку.

Надія Баловсяк зазначає, що штучний інтелект розвивається такими швидкими темпами, що ми не встигаємо адаптуватися. Коли вперше з'явився ChatGPT, виникла нова професія -- prompt engineering, яка вже встигла стати застарілою. Це спеціальність, яка фактично не дожила до свого повноцінного існування, адже тепер немає необхідності формулювати запити з такою ретельністю. Зараз існує безліч інструкцій, і кожен може легко навчитися цьому. Більше того, у режимі діалогу можна швидше та простіше уточнити запит і те, що потрібно від ChatGPT. Це означає, що освіта, наука та креативні професії також зазнають змін. Головне, щоб ці зміни приносили користь людям, а не шкоду, і щоб діти зберігали свої аналітичні здібності, вміння читати та сприймати тривалі тексти.

Наталка Соколенко: І залишатися людьми. Я думаю, це і є підсумок нашої розмови. Головне завдання -- людям залишитися людьми в епоху штучного інтелекту.

Нагадаємо, в попередніх випусках подкасту "Медіуми" говорили з Мартою Наумовою про те, як працювати з медіаграмотністю на рівні державної політики, Іриною Славінською про силу книжки в часи війни, культурний опір і про те, як читання стає жестом свободи, Сергієм Міхальковим про телеграм-канали, які під час "шахедних" атак маніпулюють емоціями й перетворюють тривогу на прибутки, Юрієм Табаченком про те, як відзначити сторіччя мовника так, щоб про нього говорила вся країна. Тетяною Трощинською та Данилом Мокриком про те, чи варто публікувати смерть у медіа, Оленою Тараненко про те, як захистити себе від медіатравми, Оксаною Полулях про штучний інтелект, що створює нову реальність, Денисом Зеленовим про роботу соцмереж "24 каналу", Дмитром Литвином про "Укрінформ", "УП", телемарафон та "офреки" для журналістів, Крістіною Гаврилюк про те, чи здатні DMA і DSA змінити правила гри на європейському ринку цифрових послуг, Олександром Педаном про співпрацю з Суспільним та інші ідеї Pedan buro, Катериною Котвіцькою з Megogo Audio про аналіз поточної ситуації та трендів у сфері дистрибуції аудіоконтенту онлайн, Галою Котовою з Viber про те, як досвід роботи під час пандемії допоміг команді Rakuten Viber зростати після початку широкомасштабного вторгнення.

Інші публікації

Популярное

В тренде